Distribució Gamma

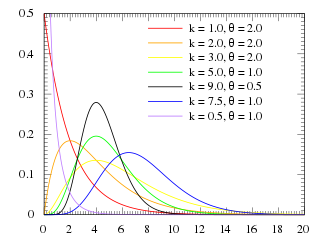

Distribució GammaFunció de densitat de probabilitat  |

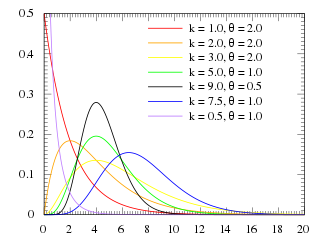

Funció de distribució de probabilitat  |

| Tipus | distribution de Tweedie, família exponencial, generalized gamma distribution (en)  , distribució matriu gamma, distribució univariant i distribució de probabilitat contínua , distribució matriu gamma, distribució univariant i distribució de probabilitat contínua  |

|---|

| Paràmetres |  forma forma escala escala

|

|---|

| Suport |  |

|---|

| fdp |  |

|---|

| FD |  |

|---|

| Esperança matemàtica |  |

|---|

| Mediana | No té expressió tancada |

|---|

| Moda |  |

|---|

| Variància |  |

|---|

| Coeficient de simetria |  |

|---|

| Curtosi |  |

|---|

| Entropia |  |

|---|

| FGM |  |

|---|

| FC |  |

|---|

| Informació de Fisher |  |

|---|

| Mathworld | GammaDistribution  |

|---|

En la teoria de la probabilitat i l'estadística, la distribució gamma és una família de distribucions contínues amb dos paràmetres que inclouen com a casos particulars moltes distribucions importants, com la distribució exponencial, khi quadrat o Erlang. Té un paràmetre d'escala θ i un paràmetre de forma k. Si k és un nombre sencer aleshores la distribució representa la suma de k variables aleatòries exponencials, cadascuna de les quals té mitjana θ. La referència bàsica d'aquest article és Johnson et al..

Funció de densitat i parametritzacions

Hi ha dues parametritzacions diferents de la distribució gamma. La primera[2] utilitza un paràmetre d'escala  i un paràmetre de forma

i un paràmetre de forma  , i és àmpliament utilitzada tant en Estadística com en Probabilitats; a més, és la més habitual en el programari estadístic.[3] La funció de densitat és

, i és àmpliament utilitzada tant en Estadística com en Probabilitats; a més, és la més habitual en el programari estadístic.[3] La funció de densitat és

|

on  és la funció gamma. Si

és la funció gamma. Si  és una variable aleatòria amb aquesta distribució, s'escriu

és una variable aleatòria amb aquesta distribució, s'escriu  o

o  .

.

La segona parametrització utilitza un paràmetre d'escala inversa, que també s'anomena paràmetre de taxa (rate parameter),  ,

,  , i el paràmetre de forma

, i el paràmetre de forma  . Aquesta parametrització també s'utilitza molt, per exemple en teoria de la probabilitat [4] o en Estadística bayesiana.[5] La funció de densitat, amb aquesta parametrització és

. Aquesta parametrització també s'utilitza molt, per exemple en teoria de la probabilitat [4] o en Estadística bayesiana.[5] La funció de densitat, amb aquesta parametrització és

En aquest article utilitzarem la primera parametrització.

Funció de distribució

on

és la

funció gamma incompleta inferior.

Propietat d'escala

Sigui  . Aleshores per qualsevol

. Aleshores per qualsevol  , tenim que

, tenim que  . Aquesta propietat es comprova calculant la funció de densitat de

. Aquesta propietat es comprova calculant la funció de densitat de  .

.

En particular, si  , aleshores

, aleshores  i, recíprocament, si

i, recíprocament, si  , aleshores

, aleshores  ; Johnson et al anomenen distribució gamma estàndard a la distribució

; Johnson et al anomenen distribució gamma estàndard a la distribució  .

.

En termes de les funcions de densitat tenim la relació

que és una de les característiques dels

paràmetres d'escala.

La propietat d'escala permet reduir diverses propietats (per exemple el càlcul dels moments) a casos més senzills.

Moments

La distribució gamma té moments de tots els ordres. Si  , aleshores per a

, aleshores per a  ,

,

![{\displaystyle E[X]=\theta k\quad {\text{i}}\quad E[X^{n}]=\theta ^{n}k(k+1)\cdots (k+n-1),\ n\geq 2.}](https://wikimedia.org/api/rest_v1/media/math/render/svg/0e0ea0a94a0cdfdf1e1a703af1776238155e2459) |

En particular,

![{\displaystyle E[X^{2}]=\theta ^{2}k(k+1),}](https://wikimedia.org/api/rest_v1/media/math/render/svg/0ae93b7afff1bcf81fa619107d8a65fa3231d5e6)

d'on

![{\displaystyle {\text{Var}}(X)=E[X^{2}]-{\big (}E[X]{\big )}^{2}=\theta ^{2}k.}](https://wikimedia.org/api/rest_v1/media/math/render/svg/e1a881b13c1811a9e8c306a9044fb9ea480f32a2)

![{\displaystyle E[X]=\theta k\quad {\text{i}}\quad {\text{Var}}(X)=\theta ^{2}k.}](https://wikimedia.org/api/rest_v1/media/math/render/svg/bbc01c86bcb9b10c7f3dfb62fcecebc8e08b4651) |

Prova

Calcularem els moments pel cas de la distribució gamma estàndard, és dir, amb

, dels quals es dedueixen els del cas general per la propietat d'escala. Reduirem la integral que intervé el càlcul dels moments a la funció gamma: Concretament, si

, llavors

![{\displaystyle E[Y^{n}]={\frac {1}{\Gamma (k)}}\int _{0}^{\infty }x^{n+k-1}e^{-x}\,dx={\frac {\Gamma (n+k)}{\Gamma (k)}}=(k+n-1)(k-n-2)\cdots k,}](https://wikimedia.org/api/rest_v1/media/math/render/svg/3cb9f7f65b21389f8caa3e41ae480b08c587cba1)

on a la darrera igualtat igualtat hem utilitzat l'equació funcional de la funció gamma

. Per a

, per la propietat d'escala, amb les notacions anteriors, tenim que

![{\displaystyle E[X^{n}]=E{\big [}(\theta Y)^{n}{\big ]}=\theta ^{n}\,E[Y^{n}].}](https://wikimedia.org/api/rest_v1/media/math/render/svg/f6c2d33e20b4ac0652c33e805c3cf534d000ec70)

Funció generatriu de moments i funció característica

La distribució gamma  té funció generatriu de moments en una semirecta que conté el zero:

té funció generatriu de moments en una semirecta que conté el zero:

Prova

De nou, començarem per la distribució gamma estàndard: Si

, llavors

Si

, fem el canvi

i tenim

.

En el cas general,  , per la propietat d'escala, si definim

, per la propietat d'escala, si definim  , llavors

, llavors  . Per les propietats de les funcions generatrius, per

. Per les propietats de les funcions generatrius, per  ,

,

![{\displaystyle M_{X}(t)=E{\big [}e^{tX}{\big ]}=E{\big [}e^{t\theta Y}{\big ]}=M_{Y}(t\theta )={\frac {1}{(1-t\theta )^{k}}}.}](https://wikimedia.org/api/rest_v1/media/math/render/svg/c4cd7d1bbfc37a8ea29245689bbc8bdcacbf9ef0)

La funció característica és [4]

on

és la branca principal del logaritme, és a dir, amb la part imaginària a

.

Caràcter reproductiu

Si  i

i  independents, aleshores

independents, aleshores  ; és diu que la distribució

; és diu que la distribució  és reproductiva[7] respecte el paràmetre

és reproductiva[7] respecte el paràmetre  . Aquesta propietat es demostra utilitzant les funcions característiques (o les funcions generatrius de moments) de

. Aquesta propietat es demostra utilitzant les funcions característiques (o les funcions generatrius de moments) de  i

i  .

.

Més generalment, si  són independents,

són independents,  , aleshores

, aleshores

.

La distribució gamma és infinitament divisible

La distribució gamma  és infinitament divisible (o infinitament descomposable),[8] això és, sigui

és infinitament divisible (o infinitament descomposable),[8] això és, sigui  , aleshores per a qualsevol enter

, aleshores per a qualsevol enter  , existeixen (en algun espai de probabilitat) variables aleatòries

, existeixen (en algun espai de probabilitat) variables aleatòries  independents i idènticament distribuïdes tals que

independents i idènticament distribuïdes tals que

on

indica la

igualtat en distribució o llei. Aquí cal prendre

.

La representació de Lévy-Khintchine[9] de la funció característica és

Per tant, la mesura de Lévy té densitat

i la part gaussiana i la deriva (

drift) són zero (vegeu Sato

[10] per a les definicions d'aquests termes).

Aproximació de la distribució gamma per la distribució normal

En aquest apartat suposarem que el paràmetre  és un nombre natural. Sigui

és un nombre natural. Sigui  , aleshores, com conseqüència del teorema central de límit,

, aleshores, com conseqüència del teorema central de límit,

(Vegeu les notacions a

convergència de variables aleatòries.) En altres paraules, per a

gran,

és aproximadament normal

.

Prova

Sigui

una successió de variables aleatòries independents totes amb llei

(és dir, amb

distribució exponencial de paràmetre 1). Tenim que

![{\displaystyle E[T_{i}]=1}](https://wikimedia.org/api/rest_v1/media/math/render/svg/67bdbe78d39b134e83685aefa55bd609ca55619d)

i

. Llavors, pel

teorema central del límit,

Però per la propietat reproductiva,

.

Però aquesta aproximació a la distribució normal és molt lenta i el següent resultat dóna una aproximació més ràpida: Sigui  . Aleshores

. Aleshores

És a dir, per a

gran,

és aproximadament normal

.

[11] Prova

Considerem la variable aleatòria

Per la fórmula de canvi de variables, la funció de densitat de

és

Llavors es comprova que

que és la funció de densitat d'una distribució normal

. De les propietats de la

convergència en distribució es dedueix que

convergeix en distribució a una distribució

. Vegeu

[11] pels detalls.

Altres propietats

Família exponencial

La distribució gamma pertany a la família exponencial de dos paràmetres i té paràmetres naturals  i

i  , i estadístics naturals

, i estadístics naturals  i

i  .

.

Moda

Quan  , la funció de densitat de la distribució

, la funció de densitat de la distribució  té un únic màxim al punt

té un únic màxim al punt  ; és diu que aquest valor és la moda de la distribució i que la distribució és unimodal. El valor del màxim és

; és diu que aquest valor és la moda de la distribució i que la distribució és unimodal. El valor del màxim és  , que per la fórmula de Stirling, per a valors grans de

, que per la fórmula de Stirling, per a valors grans de  es pot aproximar per

es pot aproximar per  .[12]

.[12]

Quan  , aleshores la densitat no està afitada, ja que, en aquest cas,

, aleshores la densitat no està afitada, ja que, en aquest cas,

Entropía

L'entropia ve donada per

![{\displaystyle {\frac {-1}{\theta ^{k}\Gamma (k)}}\int _{0}^{\infty }{\frac {x^{k-1}}{e^{x/\theta }}}\left[(k-1)\ln x-x/\theta -k\ln \theta -\ln \Gamma (k)\right]\,dx\!}](https://wikimedia.org/api/rest_v1/media/math/render/svg/35d2648de8d74e0c63c30b64587c6106c03fc9be)

![{\displaystyle =-\left[(k-1)(\ln \theta +\psi (k))-k-k\ln \theta -\ln \Gamma (k)\right]\!}](https://wikimedia.org/api/rest_v1/media/math/render/svg/195b3b513da4f0ff84683ed831b6e991532e7fe0)

on ψ(k) és la funció digamma.

Divergència Kullback-Leibler

La divergència Kullback-Leibler entre una Γ(α0, β0) (la distribució veritable) i una Γ(α, β) (la distribució que l'aproxima) ve donada per

Transformada de Laplace

La transformada de Laplace de la distribució gamma és:

Estimació dels paràmetres

Màxima versemblança

La funció de versemblança per a N observacions iid  és

és

de la qual podem calcular la log-versemblança

L'estimador màxim-versemblant s'obté maximitzant la log-versemblança, és a dir, calculant-ne la derivada i igualant a zero (es pot demostrar que la funció és convexa i que per tant té un sol extrem). Procedint d'aquesta manera trobem que:

Substituint aquest resultat a l'expressió de la log-versemblança dona

Per trobar el màxim respecte de k cal calcular la derivada i igualar-la a zero, amb què s'obté:

on

és la funció digamma. No existeix cap fórmula tancada per a k, però la funció es comporta bé numèricament (és convex), i per tant és senzill trobar-ne una solució numèrica, per exemple amb el mètode de Newton. És possible trobar un valor inicial per a k emprant el mètode dels moments, o emprant l'aproximació

Si definim

aleshores k és aproximadament

que és dins d'un 1,5% del valor correcte.

Estimador Bayesià

Si considerem que k és conegut i  és desconegut, la funció de densitat a posteriori per a

és desconegut, la funció de densitat a posteriori per a  és (assumint que la distribució a priori és proporcional a

és (assumint que la distribució a priori és proporcional a  )

)

Definint

Per tal de calcular l'esperança cal calcular la integral respecte &theta, el qual pot dur-se a terme emprant un canvi de variables que revela que 1/&theta segueix una distribució gamma amb paràmetres  .

.

Els moments podem calcular-se especificant diferents valors per a m a la següent expressió

Per exemple, l'esperança +/- la desviació estàndard de la distribució a posteriori de  és:

és:

+/-

+/-

També és possible obtenir estimadors Bayesians sense assumir que k és conegut, però en general no és possible obtenir-ne una expressió senzilla.

Generació de valors d'una distribució gamma

Tenint en compte la propietat d'escala esmentada anteriorment, és suficient generar una variable gamma amb β = 1 i després transformar-la a qualsevol altre valor de β amb una simple divisió.

Emprant el fet que una distribució Γ(1, 1) és el mateix que una distribució exponencial Exp(1), i tenint en compte el mètode per generar variables aleatòries exponencials, arribem a la conclusió que si U prové d'una distribució uniforme en (0, 1], aleshores -ln(U) segueix una Γ(1, 1). Emprant la propietat de què la suma de variables aleatòries gamma independents segueix novament una distribució gamma, extenem el resultat:

on Uk són uniformement distribuïdesen (0, 1] i independents.

Tanmateix aquesta estratègia només funciona si n és un nombre sencer. Ara veurem com generar observacions d'una Γ(δ, 1) per a 0 < δ < 1, ja que després podem aplicar la propietat de la suma per al cas 1 < &delta.

A continuació presenten un algoritme, sense demostració. Es tracta d'un cas particular del mètode d'acceptació-rebuig:

- Sigui m= 1.

- Generar

i

i  — independents i uniformement distribuïdes a (0, 1].

— independents i uniformement distribuïdes a (0, 1]. - Si

, on

, on  , aleshores anar a 4, altrament anar a 5.

, aleshores anar a 4, altrament anar a 5. - Sigui

. Anar a 6.

. Anar a 6. - Sigui

.

. - Si

, aleshores incrementar m i tornar a 2.

, aleshores incrementar m i tornar a 2. - Assumim que

és l'observació d'una

és l'observació d'una

Per resumir,

![{\displaystyle \theta \left(\xi -\sum _{i=1}^{[k]}{\ln U_{i}}\right)\sim \Gamma (k,\theta ),}](https://wikimedia.org/api/rest_v1/media/math/render/svg/a8816ea8e64d96b972b73077057df79b9ec43fab)

on [k] és la part sencera de k, i ξ ha estat generat emprant l'algoritme que hem presentat δ = {k} (la part fraccional de k), Uk i Vl segueixen la distribució explicada anteriorment i són independents.

La Llibreria científica GNU disposa de rutines robustes per a generar observacions de moltes distribucions, incloent la distribució Gamma.

Distribucions relacionades

Casos particulars

- Si

, aleshores X segueix una distribució exponencial amb paràmetre λ.

, aleshores X segueix una distribució exponencial amb paràmetre λ. - Si

, aleshores X és idènticament distribuïda a una χ²(ν), la distribució khi-quadrat amb ν graus de llibertat.

, aleshores X és idènticament distribuïda a una χ²(ν), la distribució khi-quadrat amb ν graus de llibertat. - Si

és un nombre sencer, la distribució gamma es denomina distribució d'Erlang que serveix per a modelar el temps d'arribada fins a la

és un nombre sencer, la distribució gamma es denomina distribució d'Erlang que serveix per a modelar el temps d'arribada fins a la  -ena "arribada" en un procés de Poisson d'una dimensió amb intensitat 1/θ.

-ena "arribada" en un procés de Poisson d'una dimensió amb intensitat 1/θ.

- Si

, aleshores X segueix una distribució de Maxwell-Boltzmann amb paràmetre a.

, aleshores X segueix una distribució de Maxwell-Boltzmann amb paràmetre a.  , aleshores

, aleshores

Altres

- Si X segueix una Γ(k, θ) aleshores 1/X segueix una distribució gamma inversa amb paràmetres k i θ-1.

- Si X i Y són Γ(α, θ) i Γ(β, θ) independents, respectivament, aleshores X / (X + Y) segueix una distribució beta amb paràmetres α i β.

- Si Xi són Γ(αi,θ) independents, aleshores el vector (X1 / S, ..., Xn / S), on S = X1 + ... + Xn, segueix una distribució de Dirichlet amb paràmetres α1, ..., αn.

Distribució gamma amb tres paràmetres

Johnson et al. introdueixen la distribució gamma amb tres paràmetres: a més dels paràmetres de forma i escala  , consideren un paràmetre de posició

, consideren un paràmetre de posició  ; la distribució ve definida per la funció de densitat

; la distribució ve definida per la funció de densitat

Notes

- ↑ Forbes, C; Evans, M.; Hastings, N.; Peacock, B. Statistical distributions.. 4th ed.. Oxford: Wiley-Blackwell, 2010, p. 109. ISBN 978-0-470-62724-2.

- ↑ «The R project for statistical computing». [Consulta: 9 febrer 2023].

- ↑ 4,0 4,1 Sato, Ken-iti. Lévy processes and infinitely divisible distributions. Cambridge, U.K.: Cambridge University Press, 1999, p. 13. ISBN 0-521-55302-4.

- ↑ Bernardo, J. M.; Smith, A. F. M.. Bayesian theory. Chichester, Eng.: Wiley, 1994, p. 118. ISBN 0-471-92416-4.

- ↑ Wilks, S. S.. Mathematical statistics. Nova York: Wiley, 1962, p. 176. ISBN 0-471-94644-3.

- ↑ Loeve, Michel. Teoría de la probabilidad. Madrid: Tecnos, D.L. 1976, p. 289. ISBN 84-309-0663-0.

- ↑ Sato, Ken-iti. Lévy processes and infinitely divisible distributions. Cambridge, U.K.: Cambridge University Press, 1999, p. 45. ISBN 0-521-55302-4.

- ↑ Sato, Ken-iti. Lévy processes and infinitely divisible distributions. Cambridge, U.K.: Cambridge University Press, 1999, p. 37-39. ISBN 0-521-55302-4.

- ↑ 11,0 11,1 Williams, D. Weighing the odds : a course in probability and statistics. Cambridge: Cambridge University Press, 2001, p. 164. ISBN 0-521-80356-X.

- ↑ Feller, William. Introducción a ls probabilidades y sus aplicaciones, vol. 2. Mexico: Editorial Limua, 1978, p. 76.

Bibliografia

- Hogg, R. V. and Craig, A. Introduction to Mathematical Statistics, 4th edition. Nova York: Macmillan, 1978. (Vegeu la secció 3.3.)

- Johnson, N. L.; Kotz, S.; Balakrishnan, N. Continuous Univariate Distributions, Volume 1. 2a edició. Nova York: Wiley, 1994. ISBN 0-471-58495-9.

- Choi, S. C: and R. Wette, R. (1969) Maximum Likelihood Estimation of the Parameters of the Gamma Distribution and Their Bias, Technometrics, 11(4) 683-69

Enllaços externs

- Weisstein, Eric W., «Gamma distribution» a MathWorld (en anglès).

- Engineering Statistics Handbook

|

|---|

|

Distribucions discretes

amb suport finit | |

|---|

Distribucions discretes

amb suport infinit | |

|---|

Distribucions contínues

suportades sobre un interval acotat | |

|---|

Distribucions contínues

suportades sobre un interval semi-infinit | |

|---|

Distribucions contínues

suportades en tota la recta real | |

|---|

Distribucions contínues

amb el suport de varis tipus | |

|---|

| Barreja de distribució variable-contínua | |

|---|

| Distribució conjunta | |

|---|

| Direccionals | |

|---|

| Degenerada i singular | |

|---|

| Famílies | |

|---|

![{\displaystyle E[X]=\theta k\quad {\text{i}}\quad E[X^{n}]=\theta ^{n}k(k+1)\cdots (k+n-1),\ n\geq 2.}](https://wikimedia.org/api/rest_v1/media/math/render/svg/0e0ea0a94a0cdfdf1e1a703af1776238155e2459)

![{\displaystyle E[X^{2}]=\theta ^{2}k(k+1),}](https://wikimedia.org/api/rest_v1/media/math/render/svg/0ae93b7afff1bcf81fa619107d8a65fa3231d5e6)

![{\displaystyle {\text{Var}}(X)=E[X^{2}]-{\big (}E[X]{\big )}^{2}=\theta ^{2}k.}](https://wikimedia.org/api/rest_v1/media/math/render/svg/e1a881b13c1811a9e8c306a9044fb9ea480f32a2)

![{\displaystyle E[X]=\theta k\quad {\text{i}}\quad {\text{Var}}(X)=\theta ^{2}k.}](https://wikimedia.org/api/rest_v1/media/math/render/svg/bbc01c86bcb9b10c7f3dfb62fcecebc8e08b4651)

![{\displaystyle E[Y^{n}]={\frac {1}{\Gamma (k)}}\int _{0}^{\infty }x^{n+k-1}e^{-x}\,dx={\frac {\Gamma (n+k)}{\Gamma (k)}}=(k+n-1)(k-n-2)\cdots k,}](https://wikimedia.org/api/rest_v1/media/math/render/svg/3cb9f7f65b21389f8caa3e41ae480b08c587cba1)

![{\displaystyle E[X^{n}]=E{\big [}(\theta Y)^{n}{\big ]}=\theta ^{n}\,E[Y^{n}].}](https://wikimedia.org/api/rest_v1/media/math/render/svg/f6c2d33e20b4ac0652c33e805c3cf534d000ec70)

![{\displaystyle M_{X}(t)=E{\big [}e^{tX}{\big ]}=E{\big [}e^{t\theta Y}{\big ]}=M_{Y}(t\theta )={\frac {1}{(1-t\theta )^{k}}}.}](https://wikimedia.org/api/rest_v1/media/math/render/svg/c4cd7d1bbfc37a8ea29245689bbc8bdcacbf9ef0)

![{\displaystyle E[T_{i}]=1}](https://wikimedia.org/api/rest_v1/media/math/render/svg/67bdbe78d39b134e83685aefa55bd609ca55619d)

![{\displaystyle {\frac {-1}{\theta ^{k}\Gamma (k)}}\int _{0}^{\infty }{\frac {x^{k-1}}{e^{x/\theta }}}\left[(k-1)\ln x-x/\theta -k\ln \theta -\ln \Gamma (k)\right]\,dx\!}](https://wikimedia.org/api/rest_v1/media/math/render/svg/35d2648de8d74e0c63c30b64587c6106c03fc9be)

![{\displaystyle =-\left[(k-1)(\ln \theta +\psi (k))-k-k\ln \theta -\ln \Gamma (k)\right]\!}](https://wikimedia.org/api/rest_v1/media/math/render/svg/195b3b513da4f0ff84683ed831b6e991532e7fe0)

![{\displaystyle \theta \left(\xi -\sum _{i=1}^{[k]}{\ln U_{i}}\right)\sim \Gamma (k,\theta ),}](https://wikimedia.org/api/rest_v1/media/math/render/svg/a8816ea8e64d96b972b73077057df79b9ec43fab)